tg-me.com/knowledge_accumulator/278

Last Update:

Self-Consuming Generative Models Go MAD [2023]

Существует большой спектр ожиданий от текущего поколения AI. С оптимистичной стороны собрались сливки человечества. Там находятся авторы AI-фанфиков (таких, как ai-2027.com), описывающие с точностью до месяца события мирового масштаба на 2.5 года вперёд. Там находятся говорящие головы, подрабатывающие CEO, и думающие, что через 3-6 месяцев AI будет писать 90% кода (месяц уже прошёл). Сегодня мы с вами взглянем на ситуацию с противоположной стороны.

Первым шагом обучения любой современной модели является гигантский pretrain. Модели обучают предсказывать следующий токен в последовательности на всём интернете. До 2020 почти 100% контента на естественном языке создавали люди, но с появлением вменяемых моделей всё больше и больше контента начинает генерироваться нейросетями. В процессе продвижения knowledge cutoff вперёд всё большую долю данных в претрейне будет составлять синтетический контент. Опасно ли это?

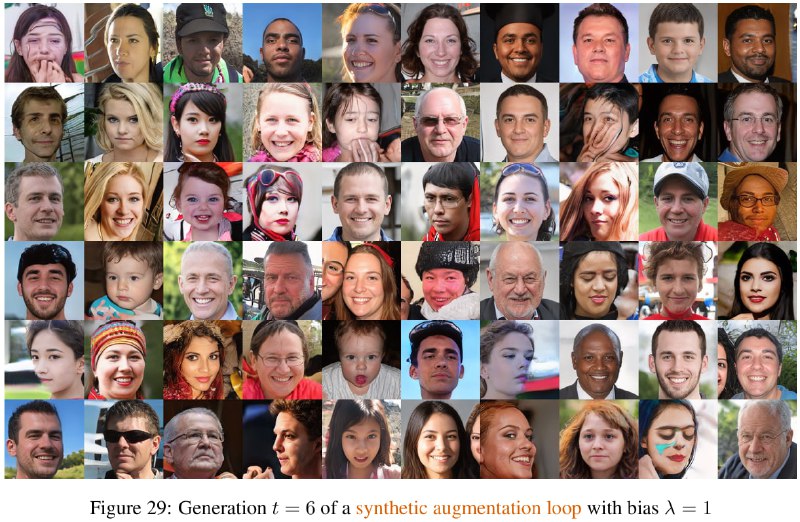

Попытку исследовать этот вопрос провели авторы сегодняшней статьи. В ней они проводили эксперименты над генеративными картиночными моделями, обучаемыми на фотографиях лиц. Рассматривалось 3 сценария:

Fully Synthetic Loop - модель каждого следующего поколения обучается только на синтетическом датасете из предыдущего поколения.

Synthetic augmentation Loop - модель каждого следующего поколения обучается на синтетическом датасете из предыдущего поколения и на фиксированном реальном датасете.

Fresh Data Loop - модель каждого следующего поколения обучается на синтетическом датасете из предыдущего поколения и на свежем реальном датасете.

Также оценивалось влияние sampling bias. В контексте ганов это обрезание хвостов нормального шума, в контексте языковых моделей эту роль, пожалуй, играет температура. Sampling bias помогает увеличить среднее качество сэмплов, жертвуя при этом их разнообразием.

И в Fully Synthetic Loop, и в Synthetic augmentation Loop (в нём доля синтетики была 50%) модель деградировала со временем. Во втором случае она предсказуемо деградировала медленнее. Усиление sampling bias замедляло падение качества, но пагубно влияло на разнообразие результата.

Сценарий с Fresh Data Loop показал более интересный результат. Итак, на каждом шаге мы дообучаем на n_r новых реальных картинках и на n_s генерациях с предыдущего шага. Качество модели в рамках этого процесса сходится к точке, которая зависит от этих 2 параметров и не зависит от первого поколения датасета.

Важно, что наличие синтетики улучшает качество в этом случае, но до какого-то предела. То, полезна ли она, определяется тем, получается ли в результате процесса модель, которая лучше, чем простая модель, обученная на n_r.

Оказывается, на это сильно влияет тот самый sampling bias. При его наличии полезность синтетики становится отрицательной выше какого-то порога, причём, этот порог не увеличивается пропорционально n_r, скорее, является константой. К сожалению, авторы берут не сильно большой диапазон параметров в этих экспериментах, но у них получилось так, что при отсутствии sampling bias синтетика вообще не вредит, даже при доле в 90%.

Конечно, на основе этой статьи нельзя делать точные предсказания будущего. Однако, глядя на текущий интернет, у меня всё же возникают опасения. Люди загружают в него всё больше и больше синтетического контента, и смысл создавать его руками лишь падает со временем. Подавляющая доля постов в соцсетях, комментариев, а со временем и картинок будет создана автоматически. Sampling bias люди используют на всю катушку, пытаясь выдать более качественный результат. Теоретически, всё это может привести к серьёзной деградации результатов претрейна с течением времени.

Ситуацию спасёт новое поколение AI, не обучающееся на всём интернете, а также мы - люди, продолжающие писать свои тексты ручками.

@knowledge_accumulator

BY Knowledge Accumulator

Share with your friend now:

tg-me.com/knowledge_accumulator/278